ТИЖНЕВИК TVP: Чим ШІ відрізняється від звичайної комп'ютерної програми?

МАРЕК ГАЙДА: Кожна програма складається з двох частин: коду, який описує, що вона повинна робити, і бази даних, яку вона використовує. Найбільша різниця полягає в тому, що у випадку ШІ програма не має багато інформації про те, що робити, але база даних у неї гігантська. Її називають «навчальним набором». Саме ми маємо чогось навчити ШІ, щоб він на основі цього виконував якісь конкретні дії. Тим часом у звичайній комп'ютерній програмі в коді все передбачено – що саме і як треба робити.

Проілюструю це на прикладі шахової партії. При класичному підході ми б описали у тисячах рядків коду всі процедури правильної гри: як рухаються пішаки та інші фігури, які ходи дозволені, які заборонені тощо. Разом з цим прописуються команди, що програма має робити в конкретних ситуаціях, наприклад, перед тим, як зробити хід, переконайтеся, що ваш пішак/фігура захищені, а якщо є багато можливих ходів, ми додаємо алгоритми вибору «меншого зла» або «більшого добра». У коді детально прописується шлях виграшу в шахи.

Підписуйтесь на наш фейсбук

Підписуйтесь на наш фейсбук

З іншого боку, створення ШІ для шахів передусім полягало б у підготовці колекції всіх зіграних ігор із важливих змагань (вони доступні в Інтернеті), без вказівки, що саме програма має з цим робити. Тобто, щось на кшталт: уважно подивись ці партії, а потім сам грай та перемагай – ось твоя мета.

Це все ще виглядає магічно. Тобто, ШІ кодує сам себе? І чи можна потім витягти з нього запис про те, що і як він підготував та виконав на основі цієї бази даних?

Власне, не зовсім можливо зазирнути «під капот», особливо у випадку нових технологій типу глибокого навчання (англ. deep learning), де програмам надаються справді дуже детальні дані, до найдрібніших деталей, при чому без надання контексту. Машина сама вирішує, як їх упорядкувати і яке їм надати значення. А кількість цих даних настільки велика, що людина не може побачити, що цей алгоритм зробив.

Таким чином ШІ може проаналізувати дані та зробити з них висновки. Тоді утворюється постійний код, який намагається працювати як людський мозок – за принципом нейронної мережі. Наприклад, у нас є два модні сьогодні додатки: один для розпізнавання марок автомобілів, а інший – для видів рослин. Обидва працюють таким чином, що фотографують об’єкт, а алгоритм вгадує, що це таке. Вони обидва базуються на ШІ та діють точно так само: це нейронна мережа, яка має навчитися «щось розпізнавати».

Чи користувач може на них впливати? Наприклад, як ботанік, я можу побачити помилку програми в класифікації рослини і виправити її для блага інших користувачів...

Деякі програми дозволяють людині коригувати рішення, видані машиною. Потім вона додасть цю відповідь до свого «навчального набору» як нову інформацію. Однак програмістської роботи в ШІ не так і багато. Є, звичайно, інженери, які пишуть ці штучні інтелекти, світлі уми, які складають базовий механізм – «модель системного мозку». А коли він вже створений, хитрість полягає в тому, щоб навчити його того, що ми хочемо, і навчити його добре, тобто надати хороші фотографії рослин, з хорошими описами, особливими випадками тощо. Адже квітка може виглядати по-різному в залежності від часу доби або умов виконання фотографій, які є вхідними даними для програми. У цьому потрібно розбиратися, тому до створення баз даних залучають також фахівців з певної галузі.

Кілька тижнів тому розробник «суперрозумного чат-бота LaMDA» від Google Блейк Лемуан заявив, що розроблений ним штучний інтелект «здобув свідомість». Відкладімо питання про те, що таке свідомість, тому що кожна наука дає тут своє визначення. Зупинимося на технічному: як Ви думаєте, що там відбулося?

Штучний інтелект працює в трьох напрямках. Перший, основний і найстаріший, це так званий business inteligence. Він використовується на великих підприємствах, які генерують величезні бази даних у таких сферах, як бухгалтерія, HR, маркетинг, продажі тощо. Менеджери очікують, що після введення цих баз даних до ШІ система побачить деякі кореляції, які неможливо помітити неозброєним оком. Input – вхід – це сирі дані, а output – вихід – теж дані, але вони вже є результатом аналізу. У business inteligence його найчастіше виконують простіші механізми, які називають machine learning – вони аналізують дані механічно і радше не підходять до них креативно.

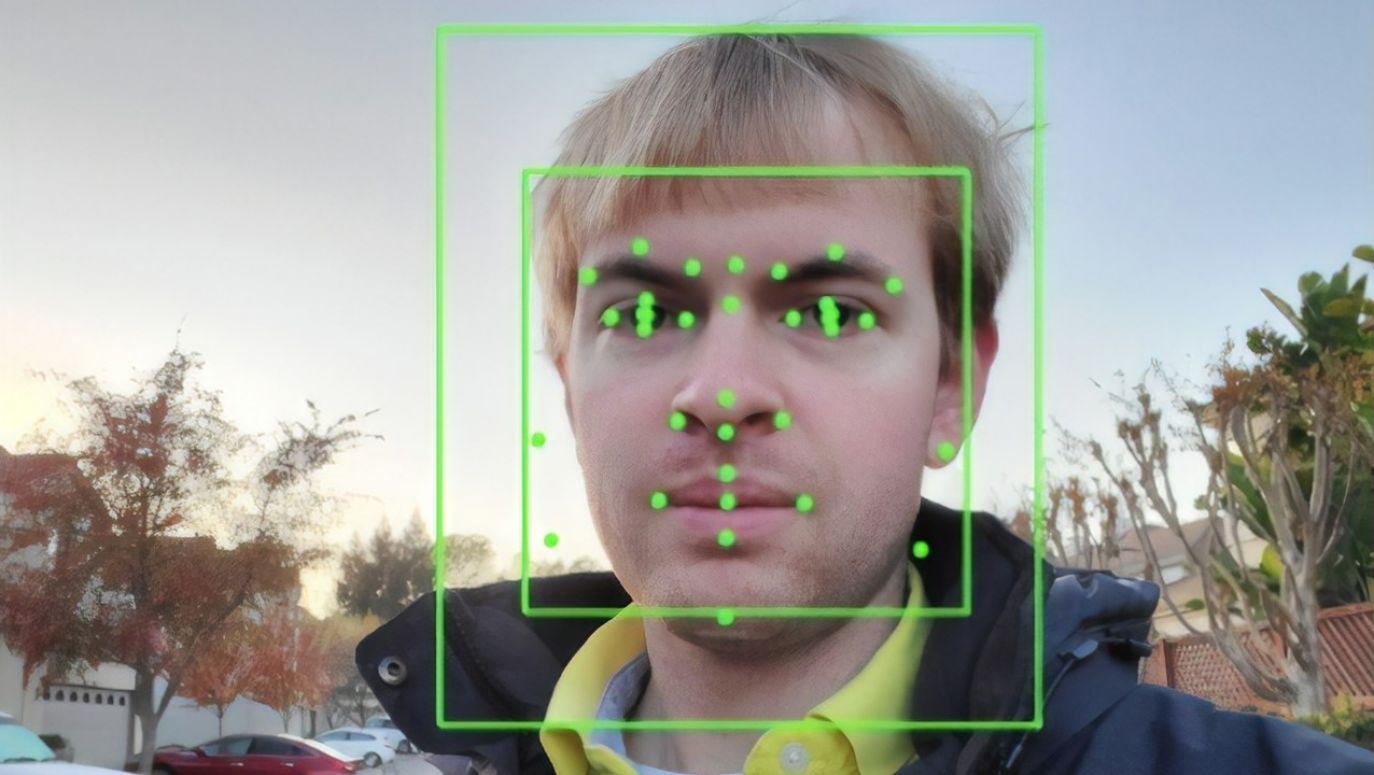

Другий напрям діяльності ШІ – це вже згадане розпізнавання речей. У різних областях: від гаджетів до серйозного цивільного (наприклад, діагностика раку на основі радіологічних методів або ідентифікація людей за біометричними даними ) та військового застосування (наприклад, розпізнавання військових об’єктів на супутникових знімках). У цій сфері ШІ допомагає людям робити те, що вони і самі можуть зробити, але на відміну від них він не втомлюється і, як ми припускаємо, не керується упередженнями.

Підписуйтесь на наш фейсбук

Підписуйтесь на наш фейсбук

З іншого боку, створення ШІ для шахів передусім полягало б у підготовці колекції всіх зіграних ігор із важливих змагань (вони доступні в Інтернеті), без вказівки, що саме програма має з цим робити. Тобто, щось на кшталт: уважно подивись ці партії, а потім сам грай та перемагай – ось твоя мета.

З іншого боку, створення ШІ для шахів передусім полягало б у підготовці колекції всіх зіграних ігор із важливих змагань (вони доступні в Інтернеті), без вказівки, що саме програма має з цим робити. Тобто, щось на кшталт: уважно подивись ці партії, а потім сам грай та перемагай – ось твоя мета.