Чому ми думаємо, що чат-бот зробить щось краще за нас, якщо ми «робимо його схожим на себе»? Так, він зробить це швидше за нас, бо для цього він і створений. Але не обов’язково точніше – тому що він існує не для того, щоб бути кращою, більш інтелектуально чесною версією нас самих, а для того, щоб бути нами з моторчиком. Цікаве свідчення про це надав у соцмережах журналіст і редактор Войцех Муха, надихнувшись технологіями ШІ. Як він писав, він навіть не встиг заварити собі чаю, а чат-бот уже зліпив із знайденої інформації великий фрагмент тексту – абзац, на написання якого у середньостатистичного стажера редакції пішло б 45 хвилин.

Бо ChatGPT шукає блискавично, але проблема в тому, що він шукає на Інтернет-ресурсах, де змішалось праведне і грішне. Де, навіть спираючись лише на ймовірно достовірну інформацію – з енциклопедій чи офіційного наукового обігу, ми все одно натрапляємо на фактичні помилки чи хибні способи вирішення задач, у тому числі простих шкільних завдань. Адже існує маса «наукових» журналів-мисливців, які полюють на гроші, тож за плату видають все, що їм надсилають. Перед цим вони не вносять жодних, навіть орфографічних виправлень, не кажучи вже про рецензії на змістову частину. А чат-бот не може належним чином перевірити знайдену інформацію.

Він сам не може визначити, що таке істина – коли його запитають про це, він витягне з мережі кілька визначень істини, сформульованих філософами і теологами, і дасть їх нам. Ми знаємо, що істиною, на думку ChatGPT, є те, що є найпоширенішою відповіддю на те чи інше питання в джерелах, які творці його бази даних вважали надійними та задали йому. Чи вчиться він самостійно перевіряти джерела, вміти відокремлювати інтернет-зерна від полови? Іноді я смію сумніватися в цьому, і наведу цьому приклади. Сьогодні ми живемо в соціальних мережах, тож це будуть приклади звідти, але лише від людей, яких я особисто знаю в реалі. Тому що в ці дивні часи ми повинні за щось триматися в плані здобування інформації.

Наш герой не впорався з простим як двері завданням з фізики. Професор, доктор наук Лех Манкевич з Центру теоретичної фізики Польської академії наук і амбасадор Академії Хана в Польщі 16 січня на своїй «стіні» описав (і підтвердив скріншотом розмови з ботом), як він намагався отримати відповідь на задане англійською мовою питання про середню швидкість автомобіля, що рухається з міста А до міста Б, відстань між якими становить 100 км. Першу половину автомобіль їхав зі швидкістю 40 км/год, а другу – 60 км/год. Бот розв'язав задачу так, ніби мова йде про першу половину часу руху, хоча не було вказано, що йдеться саме про час, але нехай. Тож професор уточнив питання, що йдеться про половину відстані, а не часу руху, але це не допомогло. Можна було прочитати той же результат, а саме: (40+60)/2=50. Важко заперечити правильність, ось тільки це аж ніяк не розв’язок ЦІЄЇ конкретної задачі.

Підписуйтесь на наш фейсбук

Підписуйтесь на наш фейсбук

Цікава і ще повчальніша річ у спілкування з цією машиною. Один із відвідувачів «стіни» професора під час дискусії поставив чат-боту те саме питання з фізики, але польською мовою. І тут відповідь була цілком правильна. Я точно не знаю, що це говорить нам про те, як часто в англомовному Інтернеті зустрічаються помилкові розв’язки задач з ньютонівської механіки, але передчуття каже мені, що нічого хорошого. Ніхто не перевіряв іспанську, французьку чи будь-яку іншу версію в обміні думками між фізиками та знайомими аматорами, але погодьмося, що – як сказав проф. Манкевич – «питань більше немає». Із ботом тут в принципі все ясно.

Село як ріка, або інтелект з пластмаси

Вчителі зі всього світу вголос нарікають, що учні почали списувати із чат-бота розв’язки домашніх завдань. Що ж, у контексті вищезгаданої історії може виявитися, що школярі зароблять незадовільну оцінку не лише за списування, а передусім за списування помилок. Польських учнів нехай захистить від спокуси сумна історія про горобчика Елемелека, який під час контрольної списав в одуда літеру В, але з трьома «животиками». Варто відновити у своїй пам’яті цей віршик і не списувати в одудів, навіть якщо вони мають розумні та сучасні назви.

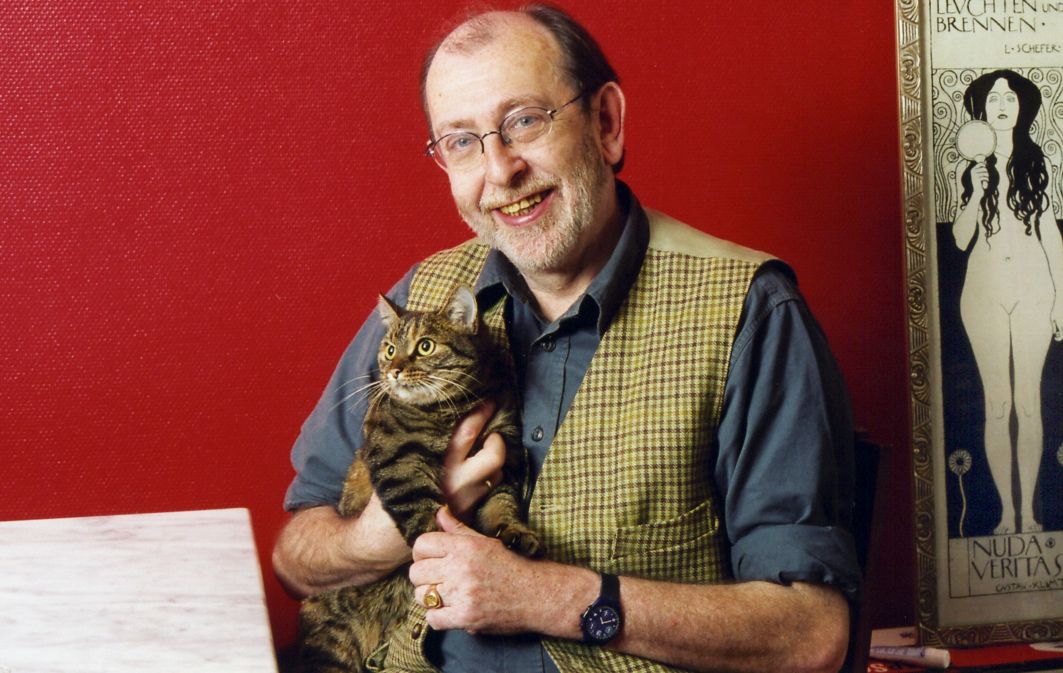

Ще кумеднішою, викладеною у тій же соцмережі, є історія контактів із ChatGPT Януша Кухарчика, доктора філософії та викладача цього предмету, перекладача з античних мов. Як великий патріот рідної Сілезії, він запитав у ChatGPT про своє рідне село Творуг Малий. Машина спочатку відповіла, що це річка в Судетах, і назвала конкретні населені пункти, через які вона нібито протікає, що додає абсурдності цій ситуації. Чистісінька географічна фантастика! Автор питання звернув увагу на те, що такої річки немає, а є село. Бот визнав, що помилився і що це село у Бендзінському повіті. Коли йому знову «пояснили», що ні, це село розташоване в Глівіцькому повіті, він це визнав і додав, що там немає річки. Знову помилка. Тож коли йому нарешті повідомили, що так, річка там є і називається вона Беравка, він додав, що там багато рибалок і що жителі черпають звідти воду.

Звичайно! Відрами на коромислах, як у романі «Над Німаном». Як людина з філософсько-сатиричним ухилом, доктор Кухарчик дотепно зауважив у своєму записі, що цей інтелект є штучним, бо він, мабуть, зроблений із пластмаси. І що ще важливіше, ця зірка нашого постмодерну «замість того, щоб написати, що вона не знає, махлює і збирає дані зі своєї штучно інтелектуальної задниці». В яблучко! Це здається мені ключовим, і тут я можу сказати, що у випадку ChatGPT досягнуто абсолютну ДОСКОНАЛІСТЬ, написану великими літерами.

Підписуйтесь на наш фейсбук

Підписуйтесь на наш фейсбук

Цікава і ще повчальніша річ у спілкування з цією машиною. Один із відвідувачів «стіни» професора під час дискусії поставив чат-боту те саме питання з фізики, але польською мовою. І тут відповідь була цілком правильна. Я точно не знаю, що це говорить нам про те, як часто в англомовному Інтернеті зустрічаються помилкові розв’язки задач з ньютонівської механіки, але передчуття каже мені, що нічого хорошого. Ніхто не перевіряв іспанську, французьку чи будь-яку іншу версію в обміні думками між фізиками та знайомими аматорами, але погодьмося, що – як сказав проф. Манкевич – «питань більше немає». Із ботом тут в принципі все ясно.

Цікава і ще повчальніша річ у спілкування з цією машиною. Один із відвідувачів «стіни» професора під час дискусії поставив чат-боту те саме питання з фізики, але польською мовою. І тут відповідь була цілком правильна. Я точно не знаю, що це говорить нам про те, як часто в англомовному Інтернеті зустрічаються помилкові розв’язки задач з ньютонівської механіки, але передчуття каже мені, що нічого хорошого. Ніхто не перевіряв іспанську, французьку чи будь-яку іншу версію в обміні думками між фізиками та знайомими аматорами, але погодьмося, що – як сказав проф. Манкевич – «питань більше немає». Із ботом тут в принципі все ясно.